Qwen3.6-Plus는 Alibaba Cloud의 Qwen 시리즈 중 가장 최신 플래그십 모델이다. 이전 세대인 Qwen 3.5 Small이 소형 온디바이스 모델에 초점을 맞췄다면, Qwen3.6-Plus는 엔터프라이즈급 에이전트 인프라를 정조준했다.

Alibaba는 이 모델을 출시하면서 "추론(Reasoning), 기억(Memory), 실행(Execution)"의 세 가지 역량을 깊게 통합했다고 설명했다. 단순히 질문에 답하는 것을 넘어, 장기 태스크를 계획하고 도구를 호출하며 결과를 검증하는 에이전트 루프 전체를 모델이 주도할 수 있도록 설계됐다.

모델은 현재 Alibaba Cloud Model Studio API를 통해 상용 버전으로 제공된다. 동시에 Hugging Face에는 일부 공개 가중치 버전도 존재하지만, 전체 파라미터 공개 여부는 확인되지 않았다.

Qwen3.6-Plus 완전 분석 — 1M 컨텍스트, SWE-bench 78.8, 에이전틱 코딩 AI의 새 기준

Alibaba가 2026년 4월 공개한 Qwen3.6-Plus를 완전 분석한다. SWE-bench Verified 78.8점, 1M 토큰 컨텍스트, Claude Opus 4.5 수준의 코딩 성능을 달성한 이 모델의 기술 사양, 벤치마크 해석, Claude Code·Cline 연동법, 그리고 현실적 한계까지 실무 관점에서 정리한다.

Qwen3.6-Plus는 Alibaba가 2026년 4월 2일 공개한 최신 플래그십 LLM으로, SWE-bench Verified 78.8점과 1M 컨텍스트 윈도우를 앞세워 에이전틱 코딩 영역에서 Claude Opus 4.5와 동급 성능을 주장한다. 오픈소스 계열 모델 중 처음으로 프로덕션 에이전트 수준의 코딩 자동화를 실현했다는 평가가 나오고 있다. 이 글은 기술 사양, 벤치마크 해석, 실무 연동 방법, 그리고 실제 선택 기준을 정리한다.

이 글이 필요한 사람: 코딩 에이전트를 직접 구축하는 개발자, Claude Code·Cline 등 AI 코딩 툴에 외부 모델을 연동하려는 팀, 오픈소스 LLM 기반 자체 인프라를 운영 중인 엔지니어링 조직

이 글이 필요한 사람: 코딩 에이전트를 직접 구축하는 개발자, Claude Code·Cline 등 AI 코딩 툴에 외부 모델을 연동하려는 팀, 오픈소스 LLM 기반 자체 인프라를 운영 중인 엔지니어링 조직

Qwen3.6-Plus란 무엇인가

핵심 사양 — 1M 컨텍스트와 에이전트 설계

Qwen3.6-Plus의 가장 눈에 띄는 특징은 기본 1M 토큰 컨텍스트 윈도우다. 별도 설정 없이 최대 약 750,000 단어 분량의 문서를 단일 요청으로 처리할 수 있다. 대형 코드베이스 전체를 컨텍스트에 넣고 리팩토링 계획을 세우거나, 장시간 에이전트 세션에서 이전 작업 기록 전체를 유지하는 데 실질적으로 활용 가능하다.

멀티모달 측면에서는 이미지와 텍스트를 함께 처리하는 기능이 추가됐다. 스크린샷에서 UI 버그를 진단하거나, 에러 로그 이미지를 직접 분석하는 시나리오에서 활용할 수 있다.

에이전트 설계 면에서는 도구 호출(Tool Calling) 정확도가 이전 세대 대비 크게 향상됐다는 게 Alibaba의 설명이다. 특히 중첩 도구 호출(nested tool calls)과 조건부 실행 흐름에서 안정성이 높아졌다고 한다.

멀티모달 측면에서는 이미지와 텍스트를 함께 처리하는 기능이 추가됐다. 스크린샷에서 UI 버그를 진단하거나, 에러 로그 이미지를 직접 분석하는 시나리오에서 활용할 수 있다.

에이전트 설계 면에서는 도구 호출(Tool Calling) 정확도가 이전 세대 대비 크게 향상됐다는 게 Alibaba의 설명이다. 특히 중첩 도구 호출(nested tool calls)과 조건부 실행 흐름에서 안정성이 높아졌다고 한다.

SWE-bench 78.8 — 이 숫자가 실제로 의미하는 것

SWE-bench Verified는 실제 GitHub 이슈를 기반으로 만들어진 코딩 에이전트 벤치마크다. 모델이 실제 소프트웨어 버그를 코드로 수정하는 능력을 측정한다. 78.8점은 약 500개의 검증된 실제 버그 중 78.8%를 자동으로 수정할 수 있다는 의미다.

이 수치를 실무 맥락에서 해석하면:

테스트 커버리지가 충분한 Python·JavaScript 프로젝트에서는 반복적인 버그 수정 작업의 상당 부분을 에이전트가 처리할 수 있는 수준이다. 단, SWE-bench의 문제 난이도 분포는 실제 프로덕션 버그보다 상대적으로 단순한 케이스가 많다는 점을 감안해야 한다.

Terminal-Bench 2.0 61.6점은 터미널 환경에서의 복합 태스크 처리 능력을 측정한 것으로, CLI 도구 자동화나 DevOps 스크립트 작성에서의 실용성을 보여준다.

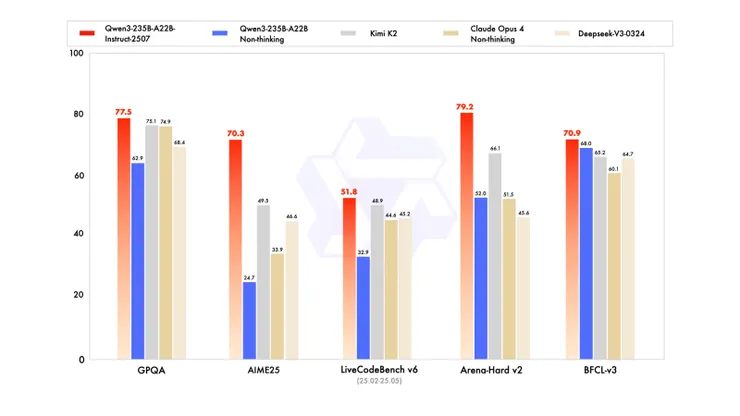

결론적으로 Qwen3.6-Plus의 코딩 성능은 프론티어 상용 모델(Claude, GPT-5.x)과 실질적으로 동일한 수준에 진입했다고 볼 수 있다. 오픈소스 계열 모델이 이 지점에 도달한 것은 처음에 가깝다.

이 수치를 실무 맥락에서 해석하면:

테스트 커버리지가 충분한 Python·JavaScript 프로젝트에서는 반복적인 버그 수정 작업의 상당 부분을 에이전트가 처리할 수 있는 수준이다. 단, SWE-bench의 문제 난이도 분포는 실제 프로덕션 버그보다 상대적으로 단순한 케이스가 많다는 점을 감안해야 한다.

Terminal-Bench 2.0 61.6점은 터미널 환경에서의 복합 태스크 처리 능력을 측정한 것으로, CLI 도구 자동화나 DevOps 스크립트 작성에서의 실용성을 보여준다.

결론적으로 Qwen3.6-Plus의 코딩 성능은 프론티어 상용 모델(Claude, GPT-5.x)과 실질적으로 동일한 수준에 진입했다고 볼 수 있다. 오픈소스 계열 모델이 이 지점에 도달한 것은 처음에 가깝다.

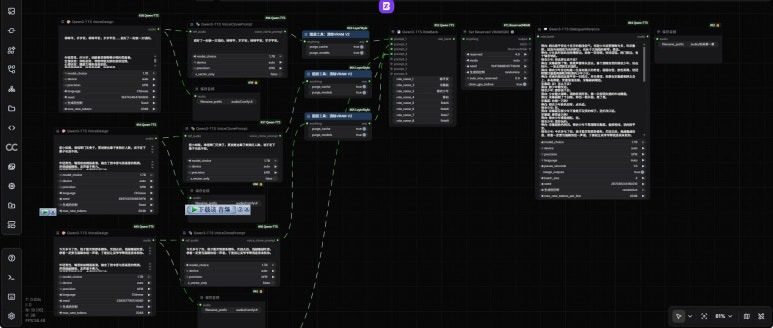

실무 연동 — Claude Code·Cline에서 Qwen3.6-Plus 쓰는 법

Qwen3.6-Plus는 OpenAI 호환 API 형식을 지원하므로, 대부분의 AI 코딩 툴에서 엔드포인트 URL과 API 키만 변경하면 연동할 수 있다. Alibaba가 공식 지원을 발표한 툴은 Claude Code, Cline, Kilo Code, OpenCode, Qwen Code다.

Claude Code에서 연동: Claude Code의 커스텀 모델 설정에서 베이스 URL을 Alibaba Cloud Model Studio 엔드포인트로 지정하고, 모델명을

Cline에서 연동: Provider를

Claude Code에서 연동: Claude Code의 커스텀 모델 설정에서 베이스 URL을 Alibaba Cloud Model Studio 엔드포인트로 지정하고, 모델명을

qwen3.6-plus로 설정하면 된다.Cline에서 연동: Provider를

OpenAI Compatible로 설정하고 동일하게 Model Studio 엔드포인트를 지정한다.Alibaba Cloud Model Studio API 연동 (Python, OpenAI SDK 호환)from openai import OpenAI # Alibaba Cloud Model Studio 엔드포인트 client = OpenAI( api_key="your-dashscope-api-key", # Alibaba Cloud API 키 base_url="https://dashscope.aliyuncs.com/compatible-mode/v1" ) response = client.chat.completions.create( model="qwen3.6-plus", messages=[ {"role": "system", "content": "You are a helpful coding assistant."}, {"role": "user", "content": "Python에서 비동기 HTTP 클라이언트를 구현해줘. httpx 사용."} ], max_tokens=4096, temperature=0.1 # 코딩 태스크에는 낮은 temperature 권장 ) print(response.choices[0].message.content)

도구 호출(Tool Calling) 예시 — 에이전트 루프import json from openai import OpenAI client = OpenAI( api_key="your-dashscope-api-key", base_url="https://dashscope.aliyuncs.com/compatible-mode/v1" ) # 도구 정의 tools = [ { "type": "function", "function": { "name": "run_tests", "description": "주어진 파일 경로에 대해 pytest 테스트를 실행하고 결과를 반환한다", "parameters": { "type": "object", "properties": { "file_path": {"type": "string", "description": "테스트할 파일 경로"} }, "required": ["file_path"] } } } ] # 에이전트 루프 response = client.chat.completions.create( model="qwen3.6-plus", messages=[{"role": "user", "content": "auth.py의 login 함수 버그를 찾아서 수정해줘"}], tools=tools, tool_choice="auto" ) # 도구 호출 결과 처리 if response.choices[0].finish_reason == "tool_calls": tool_call = response.choices[0].message.tool_calls[0] print(f"도구 호출: {tool_call.function.name}") print(f"인수: {tool_call.function.arguments}")

Qwen 3.5와 무엇이 달라졌나

Qwen 3.5 시리즈와 Qwen3.6-Plus의 차이는 단순한 성능 향상이 아니라 설계 목표의 전환이다.

Qwen 3.5 Small: 9B 파라미터, 온디바이스 추론 최적화, 소형·저비용 배포 목표. 로컬 실행이나 엣지 디바이스 시나리오에 적합하다.

Qwen3.6-Plus: 파라미터 수 미공개, 클라우드 API 배포 전용, 에이전틱 태스크 최적화. 대규모 자동화나 복잡한 코딩 에이전트를 구축하는 팀을 대상으로 한다.

두 모델은 사용 시나리오가 명확히 분리된다. 비용 효율 중심의 대량 처리라면 Qwen 3.5 Small, 복잡한 에이전트 루프나 1M 컨텍스트가 필요한 작업이라면 Qwen3.6-Plus가 적합하다.

Qwen 3.5 Small: 9B 파라미터, 온디바이스 추론 최적화, 소형·저비용 배포 목표. 로컬 실행이나 엣지 디바이스 시나리오에 적합하다.

Qwen3.6-Plus: 파라미터 수 미공개, 클라우드 API 배포 전용, 에이전틱 태스크 최적화. 대규모 자동화나 복잡한 코딩 에이전트를 구축하는 팀을 대상으로 한다.

두 모델은 사용 시나리오가 명확히 분리된다. 비용 효율 중심의 대량 처리라면 Qwen 3.5 Small, 복잡한 에이전트 루프나 1M 컨텍스트가 필요한 작업이라면 Qwen3.6-Plus가 적합하다.

현실적 한계와 선택 기준

Qwen3.6-Plus를 실제 도입할 때 고려해야 할 제약 사항이 있다.

데이터 레지던시: API 서버가 Alibaba Cloud 인프라에 위치한다. 코드나 데이터가 외부 클라우드로 전송되는 것에 민감한 조직(금융, 의료, 공공기관)은 규정 준수 여부를 먼저 확인해야 한다.

가중치 공개 범위: 전체 모델 가중치가 공개되지 않았다. 완전한 오프라인 배포나 파인튜닝을 원한다면 Qwen 3.5 Small이나 다른 완전 오픈소스 모델을 선택해야 한다.

가격 구조: Alibaba Cloud Model Studio의 토큰당 과금 체계는 Claude나 OpenAI 대비 저렴한 것으로 알려져 있지만, 대규모 에이전트 운영 시 실제 비용은 컨텍스트 크기와 호출 빈도에 따라 크게 달라진다. 프로덕션 도입 전에 반드시 비용 시뮬레이션을 수행해야 한다.

영어 우선 훈련: 한국어·한자 처리에서 Claude나 GPT 대비 품질 차이가 발생할 수 있다. 한국어 코드 주석이나 문서 생성이 중요한 프로젝트라면 실제 테스트가 필요하다.

데이터 레지던시: API 서버가 Alibaba Cloud 인프라에 위치한다. 코드나 데이터가 외부 클라우드로 전송되는 것에 민감한 조직(금융, 의료, 공공기관)은 규정 준수 여부를 먼저 확인해야 한다.

가중치 공개 범위: 전체 모델 가중치가 공개되지 않았다. 완전한 오프라인 배포나 파인튜닝을 원한다면 Qwen 3.5 Small이나 다른 완전 오픈소스 모델을 선택해야 한다.

가격 구조: Alibaba Cloud Model Studio의 토큰당 과금 체계는 Claude나 OpenAI 대비 저렴한 것으로 알려져 있지만, 대규모 에이전트 운영 시 실제 비용은 컨텍스트 크기와 호출 빈도에 따라 크게 달라진다. 프로덕션 도입 전에 반드시 비용 시뮬레이션을 수행해야 한다.

영어 우선 훈련: 한국어·한자 처리에서 Claude나 GPT 대비 품질 차이가 발생할 수 있다. 한국어 코드 주석이나 문서 생성이 중요한 프로젝트라면 실제 테스트가 필요하다.

도입 전 체크리스트:

1. 코드·데이터가 Alibaba Cloud 인프라로 전송되는 것이 규정상 허용되는가

2. 1M 컨텍스트가 실제로 필요한가, 아니면 비용 낭비인가

3. 한국어 생성 품질이 중요한 워크플로우가 있는가

4. Alibaba Cloud Model Studio 계정과 API 키 발급이 완료됐는가

공식 API 문서: Alibaba Cloud — Qwen3.6-Plus 공식 블로그

1. 코드·데이터가 Alibaba Cloud 인프라로 전송되는 것이 규정상 허용되는가

2. 1M 컨텍스트가 실제로 필요한가, 아니면 비용 낭비인가

3. 한국어 생성 품질이 중요한 워크플로우가 있는가

4. Alibaba Cloud Model Studio 계정과 API 키 발급이 완료됐는가

공식 API 문서: Alibaba Cloud — Qwen3.6-Plus 공식 블로그

QwenQwen3.6-PlusAlibabaAI모델코딩AI에이전틱AISWE-benchLLM오픈소스Claude Code 연동

관련 도구

Claude Opus 4.6LLM 모델

Anthropic 최상위 플래그십 (2026.02). 1M 컨텍스트 표준가, 128K 출력, 코딩·추론 벤치...

Claude Sonnet 4.6LLM 모델

2026년 최고 가성비 API 모델. Opus 4.6 품질에 1/5 가격, 1M 컨텍스트 표준가 적용.

Claude Haiku 4.5LLM 모델

Anthropic 최속·최경량 모델 (2025.10). Sonnet 4 수준 코딩 성능을 $1/1M 입력가,...

GPT-5.4LLM 모델

OpenAI 최신 플래그십 (2026.03). 1.05M 컨텍스트, AIME 2025 수학 100%, 128...