Mistral AI가 2026년 3월 17일 NVIDIA GTC에서 공개한 Forge는 기업이 자체 데이터로 프론티어급 AI 모델을 직접 학습시키는 플랫폼이다. 사전학습부터 강화학습까지 전 과정을 지원하며, ASML·ESA·싱가포르 국방과학기술청이 초기 파트너로 참여했다. RAG만으로 한계를 느끼는 엔터프라이즈 팀이라면 주목해야 할 대안이다.

이 글이 필요한 사람- 자사 데이터로 커스텀 LLM을 학습시키려는 ML 엔지니어

- RAG 파이프라인의 정확도 한계에 부딪힌 팀

- 규제·보안 요건 때문에 퍼블릭 API를 쓸 수 없는 금융/의료/국방 조직

- Mistral 모델을 프로덕션에서 사용 중이거나 도입을 검토하는 팀

※ 이 글은 2026년 3월 기준, Mistral AI 공식 발표 및 GTC 프레젠테이션 기반으로 작성됐습니다.

Forge는 기업이 내부 문서·코드·운영 데이터·정책을 바탕으로 자체 AI 모델을 처음부터 학습할 수 있게 해주는 엔드투엔드 플랫폼이다. 기존의 파인튜닝 API와 근본적으로 다른 점은, 사전학습(pre-training)까지 지원한다는 것이다.

Forge가 커버하는 학습 파이프라인은 세 단계다.

- 사전학습(Pre-training): 대규모 내부 데이터셋으로 도메인 인식 기초 모델을 구축한다

- 후속학습(Post-training): 특정 태스크·환경에 맞게 모델 행동을 정밀 조정한다

- 강화학습(RL): 내부 정책·평가 기준·운영 목표에 따라 모델을 정렬한다

또한 데이터 수집·큐레이션·합성 데이터 생성까지 Mistral이 자체 모델 학습에서 검증한 데이터 파이프라인을 함께 제공한다.

엔터프라이즈 AI 도입 시 가장 흔한 선택지는 RAG(검색 증강 생성)와 파인튜닝이다. Forge는 이 둘과 어떻게 다른가?

RAG는 빠르게 시작할 수 있지만, 모델이 도메인을 진정으로 이해하지는 못한다. 검색 결과에 의존하므로 복잡한 추론이나 도메인 특화 판단에서 한계가 있다. 파인튜닝은 출력 스타일을 바꾸는 데 효과적이지만, 기초 지식 자체를 바꾸기는 어렵다.

Forge는 사전학습 단계부터 내부 데이터를 주입하므로, 모델이 도메인 용어·맥락·관행을 기초 지식으로 보유한다. 대신 데이터 양과 학습 비용이 크기 때문에, 모든 기업에 적합한 것은 아니다.

Forge는 출시와 함께 5개 기관이 초기 파트너로 참여했다.

- ASML: 반도체 장비 제조 공정의 문서·설계 데이터를 기반으로 엔지니어링 어시스턴트 모델을 구축한다

- 유럽우주국(ESA): 위성 데이터·과학 논문을 학습한 우주과학 특화 모델을 개발한다

- DSO National Laboratories (싱가포르): 국방과학 연구 데이터 기반 분석 모델

- Home Team Science and Technology Agency (싱가포르): 공공안전 영역 AI 모델

- Reply: IT 컨설팅 업무 자동화용 커스텀 모델

반도체, 우주, 국방, 컨설팅까지 도메인이 다양한 것은, Forge가 특정 산업에 국한되지 않는 범용 학습 플랫폼임을 보여준다.

Forge는 모든 기업에 적합한 솔루션이 아니다. 아래 기준으로 판단하면 된다.

Forge가 적합한 경우:

- 내부 데이터가 수십 GB 이상이고, RAG로는 정확도가 부족한 경우

- 규제 요건(금융·의료·국방)으로 외부 API에 데이터를 보낼 수 없는 경우

- 도메인 전문 용어가 많아 범용 모델이 자주 틀리는 경우

- ML 엔지니어가 팀에 있어 학습 파이프라인을 관리할 수 있는 경우

Forge가 과한 경우:

- 내부 문서 QA 수준이면 RAG로 충분하다

- 출력 톤·형식만 바꾸고 싶다면 파인튜닝이 적절하다

- 학습 데이터가 부족하거나 ML 인력이 없는 소규모 팀

Mistral AI CEO Arthur Mensch는 Forge 발표와 함께 올해 연간 반복 매출(ARR) 10억 달러 돌파를 전망했다. 프랑스 스타트업이 이 수준의 매출을 달성한다면, OpenAI·Anthropic·Google과의 경쟁에서 엔터프라이즈 시장을 확실히 공략하고 있다는 신호다.

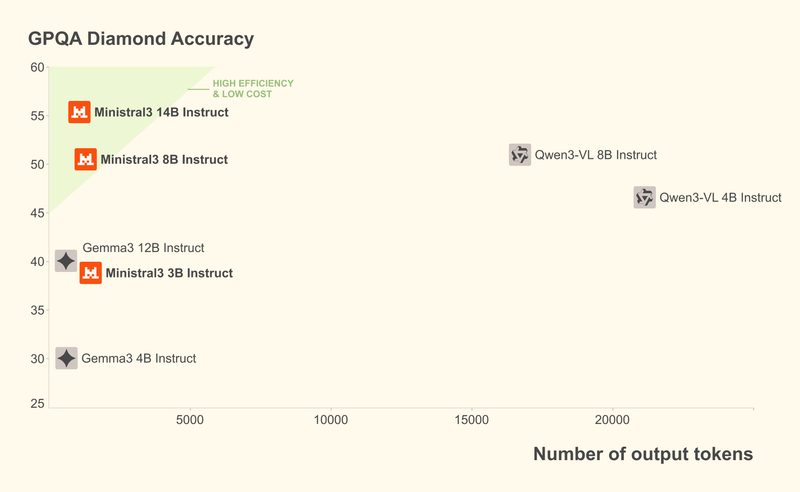

Forge와 함께 공개된 Mistral Small 4는 Forge에서 파인튜닝할 수 있는 경량 기초 모델이다. 대규모 사전학습이 필요 없는 기업은 Small 4를 파인튜닝하고, 깊은 도메인 지식이 필요한 기업은 Forge로 사전학습부터 시작하는 투트랙 전략이다.

이 전략은 OpenAI의 GPT Store·Custom Models 서비스, Anthropic의 Claude for Enterprise와 직접 경쟁하는 포지셔닝이다. 차이점은 Mistral이 사전학습까지 개방한다는 것으로, 데이터 주권을 중시하는 유럽·아시아 기업에 강력한 차별점이 된다.