한 줄 요약: 2026년 3월 기준, AI 코딩 에이전트 시장은 Claude Code(SWE-bench 80.9%), Gemini 3.1 Pro(80.6%), GPT-5.4 Codex가 0.8점 차이 내에서 경쟁하는 3강 구도로 재편됐다. 단일 모델 의존 시대는 끝났고, 작업별 최적 모델을 선택하는 멀티 모델 전략이 표준이 됐다.

이 글이 필요한 사람- AI 코딩 도구 선택을 고민하는 개발자·테크 리드

- Claude Code, Codex, Gemini의 실제 성능 차이가 궁금한 경우

- AI 코딩 에이전트의 "자율 개발" 수준이 실무에서 어디까지인지 파악하고 싶은 경우

- 2026년 AI 코딩 도구 비용 대비 성능을 비교하고 싶은 경우

※ 이 글은 2026년 3월 기준, SWE-bench Verified·LogRocket·SmartScope 벤치마크 데이터 기반으로 작성됐습니다.

2026년 3월 기준, SWE-bench Verified는 AI 코딩 에이전트의 실제 소프트웨어 엔지니어링 능력을 측정하는 가장 널리 인용되는 벤치마크다. 상위 3개 모델의 성능 차이가 1점 미만으로 좁혀진 것이 이번 분기의 핵심 변화다.

| 모델/에이전트 | SWE-bench Verified | 컨텍스트 윈도우 | 가격 (입력/출력, M토큰) |

|---|

| Claude Code (Opus 4.6) | 80.9% | 200K (1M 베타) | $15 / $75 |

| Claude Opus 4.6 (raw) | 80.8% | 200K | $15 / $75 |

| Gemini 3.1 Pro | 80.6% | 2M | $2 / $12 |

| GPT-5.4 Codex | ~80% | 1M (실험적) | $5 / $25 |

| Claude Sonnet 4.6 | 75.6% | 200K | $3 / $15 |

주목할 점은 Claude Code가 raw Opus 4.6보다 0.1% 높다는 것이다. Anthropic의 에이전트 엔지니어링(도구 사용 패턴, 재시도 로직, 컨텍스트 관리)이 모델 자체의 성능을 넘어서는 결과를 만든다는 의미다.

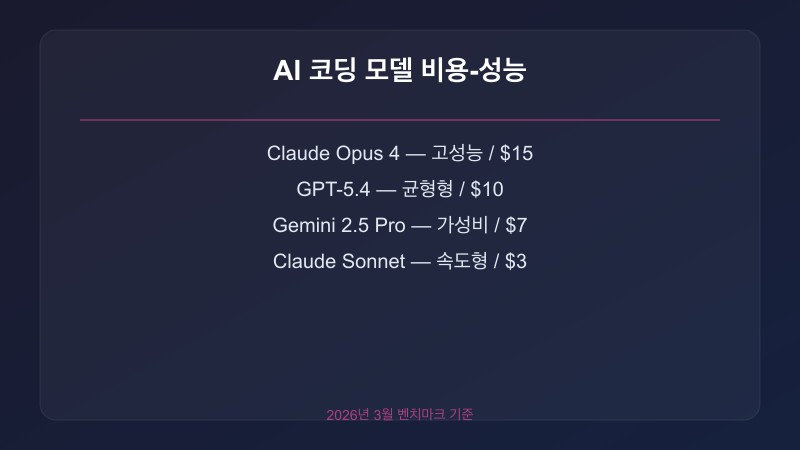

성능 격차가 1점 미만으로 좁혀지면서, 비용이 모델 선택의 핵심 변수가 됐다. Gemini 3.1 Pro는 SWE-bench 80.6%를 $2/$12(M토큰)에 제공한다. 같은 벤치마크에서 0.3점 높은 Claude Code(Opus 4.6)는 $15/$75로 약 6~7배 비싸다.

100만 토큰 기준 비용 비교

- Gemini 3.1 Pro: 입력 $2 + 출력 $12 = 가장 저렴

- Claude Sonnet 4.6: 입력 $3 + 출력 $15 = 중간 가격대에서 GDPval-AA Elo 1위

- GPT-5.4: 입력 $5 + 출력 $25 = 컴퓨터 사용 기능 포함

- Claude Opus 4.6: 입력 $15 + 출력 $75 = SWE-bench 최고, 비용도 최고

SmartScope(smartscope.blog)의 분석에 따르면, 대부분의 일상적 코딩 작업에서 Gemini 3.1 Pro와 Claude Sonnet 4.6이 Opus 4.6 대비 90% 이상의 결과를 1/5~1/6 비용으로 달성한다. Opus 4.6은 복잡한 멀티파일 리팩토링이나 아키텍처 수준의 판단이 필요한 작업에서 차이를 보인다.

2026년 AI 코딩 에이전트의 가장 큰 변화는 단순 코드 완성을 넘어 장시간 자율 실행이 가능해졌다는 점이다. 에이전트가 수 분에서 수 시간 동안 독립적으로 작업을 수행하고, 완료 후 PR을 생성하는 것이 표준 워크플로우가 됐다.

주요 에이전트별 자율 개발 기능

- Claude Code: 멀티 에이전트 조율(서브에이전트를 병렬 실행), 200K 컨텍스트 내에서 대규모 코드베이스 탐색, 자동 PR 생성, GitHub Actions 연동

- Codex (OpenAI): 클라우드 네이티브 샌드박스에서 병렬 실행, 격리된 워크트리에서 작업 후 리뷰 가능한 diff 생성, GitHub 딥 통합

- Gemini Code Assist: 2M 컨텍스트로 대규모 모노레포 전체를 한 번에 로드, 멀티파일 변경 제안

- Windsurf: Arena Mode(블라인드 모델 비교), Plan Mode(작업 계획 수립), 실시간 협업

다만, 최근 연구(techxplore.com)에 따르면 AI 코딩 도구는 구조화된 개발 작업에서 약 75%의 정확도를 보이며, 오픈소스 모델은 65% 수준에 머문다. 인간 리뷰 없이 AI가 생성한 코드를 프로덕션에 배포하는 것은 여전히 권장되지 않는다.

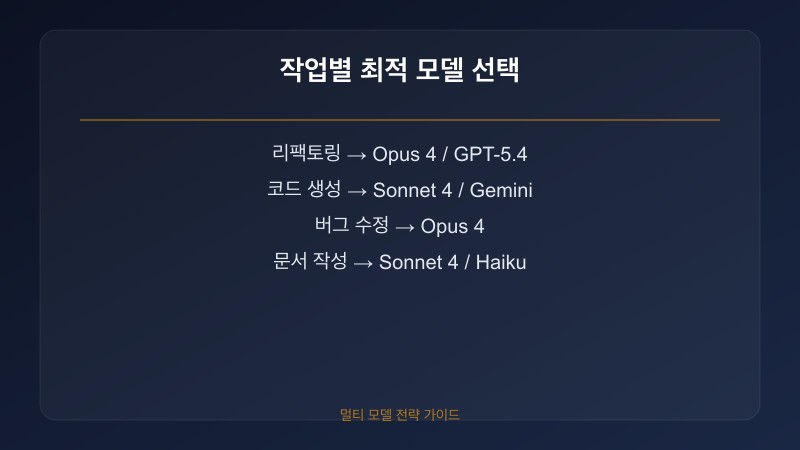

LogRocket(blog.logrocket.com/ai-dev-tool-power-rankings/)과 NxCode의 2026년 3월 분석이 공통적으로 지적하는 것은, 가장 생산적인 개발자들은 단일 모델에 의존하지 않는다는 점이다. 작업 유형에 따라 최적 모델이 다르기 때문이다.

작업별 추천 모델 가이드

| 작업 유형 | 추천 모델 | 이유 |

|---|

| 아키텍처 설계, 복잡한 리팩토링 | Claude Opus 4.6 | 최고 추론 능력, 멀티파일 이해 |

| 일상적 코딩, 빠른 반복 | Claude Sonnet 4.6 | GDPval-AA Elo 1위, 비용 효율 |

| 대규모 코드베이스 분석 | Gemini 3.1 Pro | 2M 컨텍스트, 최저 비용 |

| GUI 자동화, 크로스 앱 작업 | GPT-5.4 | 네이티브 컴퓨터 사용 기능 |

| 빠른 프로토타이핑, 비용 최소화 | Gemini 3.1 Pro | SWE-bench 80.6%를 $2/$12에 |

핵심은 "어떤 모델이 최고인가"가 아니라 "이 작업에 어떤 모델이 최적인가"를 판단하는 능력이다. 2026년의 생산적인 개발자는 모델 선택 자체를 엔지니어링 판단의 일부로 취급한다.

2026년 3월 TechXplore(techxplore.com/news/2026-03-ai-coding-tools.html) 보도에 따르면, 주요 AI 코딩 도구의 구조화된 개발 작업 정확도는 약 75%다. 이 수치가 의미하는 것은 다음과 같다.

- 4번 중 1번은 수정이 필요하다: AI가 생성한 코드를 그대로 커밋하면 4번 중 1번은 버그를 포함할 수 있다

- 오픈소스 모델은 65%: 상용 모델 대비 약 10%p 낮은 정확도. 비용 절감을 위해 오픈소스 모델을 쓸 경우 리뷰 부담 증가

- 구조화되지 않은 작업에서는 정확도가 더 낮다: 벤치마크는 구조화된 태스크 기준. 실제 프로덕션의 복잡한 요구사항에서는 정확도가 더 떨어질 수 있다

개발자의 85%가 AI 코딩 도구를 사용한다는 2026년 통계와, 75% 정확도라는 한계를 함께 놓고 보면, AI 코딩 도구는 생산성 도구이지 판단 대체 도구가 아니다라는 결론이 나온다. 코드 리뷰 프로세스를 약화시키지 않는 것이 핵심이다.